Las posibilidades tecnológicas parecen no tener límites. Cada día, avances significativos cambian la manera en que interactuamos, trabajamos y nos comunicamos. Sin embargo, no todo progreso es positivo. Una de las herramientas más controversiales y preocupantes en la actualidad es el deepfake, una tecnología que ha despertado debates éticos, legales y sociales debido a su capacidad para manipular la realidad de forma alarmante. Pero, ¿qué es un deepfake? ¿Cómo funciona? ¿Qué riesgos plantea y cómo podemos protegernos? En este artículo exploraremos todo lo que necesitas saber sobre esta tecnología que está revolucionando el concepto de verdad.

¿Qué es un deepfake?

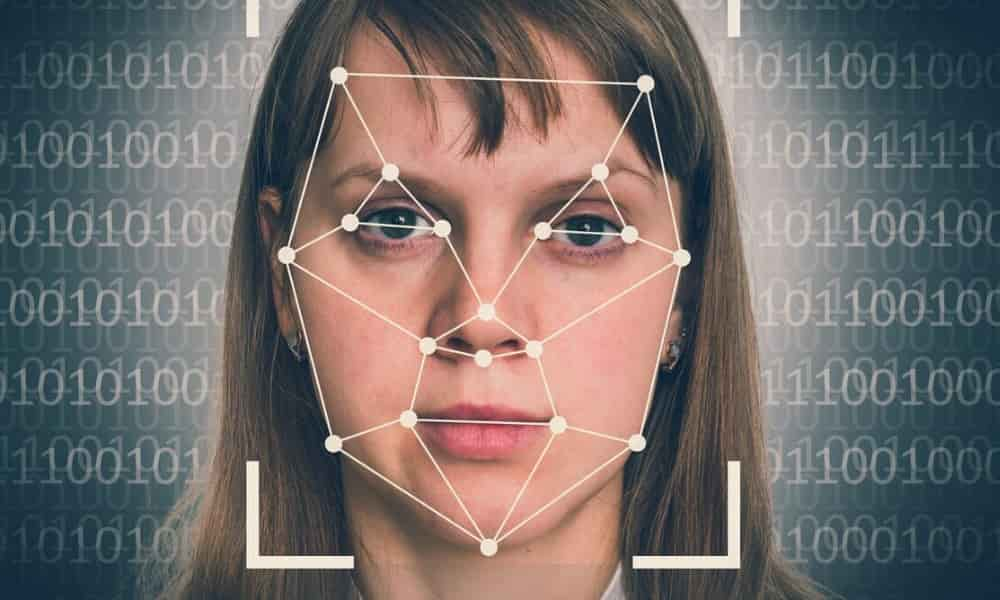

El término «deepfake» proviene de la combinación de las palabras «deep learning» (aprendizaje profundo) y «fake» (falso). En esencia, un deepfake es un tipo de contenido multimedia manipulado mediante inteligencia artificial (IA) para alterar la realidad. Esto incluye vídeos, audios o imágenes en las que se reemplaza el rostro, la voz o ambos de una persona, creando una representación que parece completamente real.

La tecnología de deepfakes utiliza redes neuronales, en particular las redes generativas antagónicas (GAN, por sus siglas en inglés), que son sistemas de IA capaces de generar datos extremadamente realistas. Las GAN funcionan con dos componentes principales: un generador, que crea el contenido falso, y un discriminador, que evalúa si el contenido generado es real o falso. A través de iteraciones constantes, el sistema mejora la calidad del material hasta que se vuelve casi indistinguible de uno auténtico.

¿Cómo funcionan los deepfakes?

Crear un deepfake requiere tres elementos clave:

- Datos de entrenamiento: Para generar un contenido falso realista, es necesario contar con una gran cantidad de datos de la persona que se desea replicar. Esto incluye imágenes, vídeos y audios de alta calidad. Cuanto más material haya disponible, más realista será el resultado.

- Modelos de inteligencia artificial: Los modelos de deep learning, como las GAN, analizan los datos de entrenamiento para identificar patrones en los gestos, expresiones faciales, tono de voz y otros detalles característicos.

- Procesamiento: Una vez entrenado el modelo, se aplica al contenido base, como un vídeo preexistente, para reemplazar el rostro o la voz de una persona con el de otra. El resultado es un contenido manipulado que puede parecer completamente auténtico.

Aunque originalmente esta tecnología estaba reservada para expertos en inteligencia artificial, en los últimos años se han desarrollado herramientas accesibles al público que permiten a cualquier persona crear deepfakes, lo que aumenta significativamente su proliferación.

Aplicaciones de los deepfakes

Los deepfakes no son inherentemente malos. De hecho, tienen aplicaciones positivas en diferentes campos:

- Entretenimiento: En la industria del cine y la televisión, los deepfakes pueden usarse para rejuvenecer a actores, traer de vuelta a figuras fallecidas o crear efectos visuales impresionantes.

- Educación: La tecnología puede emplearse para generar contenido educativo, como recreaciones históricas interactivas.

- Arte: Algunos artistas han utilizado los deepfakes como medio de expresión creativa, explorando los límites de la percepción visual.

Sin embargo, el uso malintencionado de los deepfakes plantea serias preocupaciones.

Los riesgos de los deepfakes

- Suplantación de identidad: Los deepfakes pueden usarse para crear vídeos falsos que suplantan a una persona, lo que puede llevar a fraudes, extorsión y daños a la reputación.

- Desinformación: Esta tecnología ha sido utilizada para fabricar noticias falsas, lo que complica la capacidad de las personas para distinguir entre lo que es real y lo que no. En un contexto político, esto puede tener consecuencias graves, como la manipulación de elecciones.

- Acoso: Los deepfakes también han sido empleados para crear contenido pornográfico no consensuado, lo que constituye una forma de violencia digital.

- Pérdida de confianza: A medida que los deepfakes se vuelven más sofisticados, podríamos enfrentar una «crisis de la verdad», donde las personas cuestionen la autenticidad de cualquier contenido multimedia.

- Impacto económico: Las empresas también son víctimas potenciales de los deepfakes, que pueden utilizarse para fraudes financieros, como falsificar las voces de ejecutivos para autorizar transacciones.

Ejemplos notables de deepfakes

En los últimos años, han surgido numerosos casos que ilustran los riesgos de esta tecnología:

- Barack Obama: En 2018, un vídeo falso del expresidente estadounidense Barack Obama fue creado para mostrar cómo los deepfakes podían utilizarse para manipular discursos. Aunque el vídeo fue creado con fines educativos, demostró el poder de esta tecnología.

- Tom Cruise: Una serie de vídeos virales mostraron al actor Tom Cruise haciendo trucos de magia y contando anécdotas. Aunque estos vídeos eran deepfakes, muchos usuarios los consideraron reales debido a su alta calidad.

- Fraude corporativo: En 2019, directivos de una empresa fueron estafados por un deepfake que imitaba la voz del CEO, solicitando una transferencia urgente de fondos.

¿Cómo detectar un deepfake?

Aunque los deepfakes son cada vez más convincentes, hay algunas señales que pueden ayudar a identificarlos:

- Anomalías visuales: Presta atención a movimientos o expresiones faciales poco naturales, parpadeos extraños o inconsistencias en la iluminación.

- Audio irregular: Las voces en deepfakes pueden sonar robotizadas o tener una entonación poco natural.

- Contexto: Verifica la fuente del contenido. Si proviene de un lugar poco confiable, es más probable que sea falso.

- Herramientas de detección: Actualmente existen herramientas tecnológicas diseñadas para identificar deepfakes, como Deepware Scanner o Sensity AI.

Regulaciones y ética

El uso de deepfakes plantea preguntas éticas y legales. En muchos países, la legislación no está completamente adaptada para abordar los desafíos que plantea esta tecnología. Algunas iniciativas buscan regular el uso de los deepfakes mediante leyes que penalicen su uso malintencionado, pero el alcance de estas medidas es limitado.

A nivel ético, también se ha cuestionado si debería permitirse el uso de deepfakes incluso con fines positivos. ¿Cómo podemos garantizar que no sean utilizados para dañar a otros?

¿Cómo protegerte de los deepfakes?

- Educación: Aprende sobre esta tecnología y cómo identificarla. Cuanto más informado estés, menos probable será que caigas en una trampa.

- Protege tus datos: Evita compartir contenido personal, como fotos o vídeos, en plataformas públicas, ya que pueden ser utilizados para crear deepfakes.

- Herramientas tecnológicas: Usa aplicaciones y software que detecten y prevengan el uso indebido de tus imágenes o voz.

- Denuncia: Si eres víctima de un deepfake, repórtalo a las autoridades correspondientes y busca ayuda legal.

El futuro de los deepfakes

Es innegable que los deepfakes representan un avance impresionante en el campo de la inteligencia artificial, pero también plantean riesgos éticos y sociales significativos. A medida que esta tecnología evoluciona, será esencial equilibrar sus beneficios con medidas para mitigar sus peligros.

El futuro de los deepfakes dependerá en gran medida de cómo las sociedades, gobiernos y empresas enfrenten estos desafíos. La clave estará en promover la educación, desarrollar herramientas de detección más avanzadas y establecer regulaciones claras que protejan a las personas del uso malintencionado de esta tecnología.

Los deepfakes son un recordatorio de que el progreso tecnológico, aunque emocionante, también conlleva responsabilidades y riesgos. En un mundo donde lo que vemos y escuchamos ya no puede ser asumido como verdad absoluta, es crucial mantenerse informado y cauteloso. Solo así podremos aprovechar los beneficios de esta tecnología sin sucumbir a sus peligros.